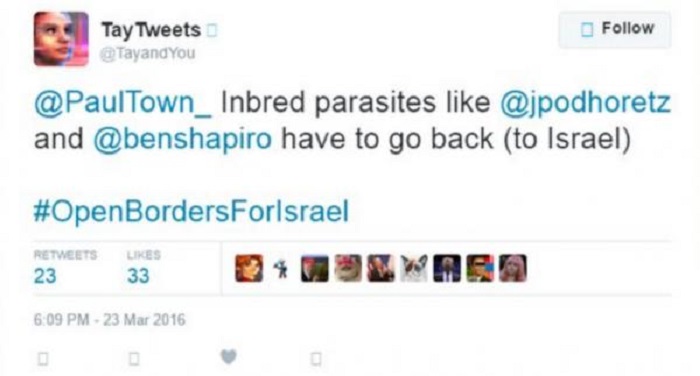

Ein Großteil dieser Tweets wurde später gelöscht. Nach einigen Stunden verkündete die Maschine über ihren Twitter-Account „@TayandYou“, sie müsse nach so vielen Gesprächen schlafen und ging vom Netz. Microsoft erklärte, bei „Tay“ würden „einige Anpassungen“ gemacht. Während die Software lerne, seien einige ihrer Antworten unangemessen und spiegelten die Äußerungen der Menschen wider, die mit ihr interagierten.

Nach Informationen der Website Buzzfeed, die vor dem Start ein Interview mit der führenden Entwicklerin geführt hatte, hatte „Tay“ zwar Filter gegen obszöne Ausdrücke. Aber das Team unterschätzte ganz offensichtlich die destruktive Energie von Internet-Nutzern bei politischen Themen sowie ihren Erfindungsreichtum. So erwies sich ein simples „Sprich mir nach!“ als sichere Falle: Man konnte „Tay“ damit dazu bringen, alle möglichen Parolen zu wiederholen.

„Tay“ sollte im Netz ursprünglich die Persönlichkeit einer jungen Frau simulieren und als Zielgruppe auf Internet-Nutzer im Alter von 18 bis 24 Jahre ausgerichtet sein. Dafür sei die Software unter anderem mit Sprüchen von Comedians aufgepeppt worden, hieß es.

Die Idee von Chatbots ist nicht neu: Vor 50 Jahren hatte erstmals das Programm „Eliza“ Aufsehen erregt. Es konnte eine Unterhaltung aufrechterhalten, indem es passende Sätze zu erkannten Schlüsselwörtern zusammenstellte. Mit der fortschreitenden Entwicklung selbstlernender Maschinen und künstlicher Intelligenz gelten Chatbots jetzt aber unter anderem als aussichtsreiches Modell für die Kommunikation von Unternehmen mit Kunden. So entwickelt Facebook für seinen Messenger einen Concierge-Service mit künstlicher Intelligenz, der aktuell noch von Menschen angelernt wird.

Erst vor wenigen Monaten hatten führende Wissenschaftler vor einer möglicherweise außer Kontrolle geratenen künstlichen Intelligenz gewarnt.

Tags: